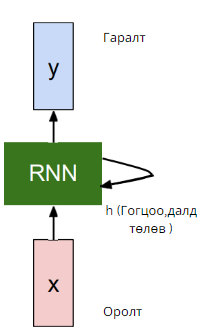

RNNs буюу Recurrent neural networks нь дараалсан өгөгдлийг боловсруулахад зориулагдсан мэдрэлийн сүлжээний нэг төрөл юм.

Энгийн мэдрэлийн сүлжээнээс ялгаатай нь RNN нь гогцоотой бөгөөд энэ нь өмнөх мэдээллээ ашиглах боломжийг олгодог. RNN гол онцлог нь санах ой. Өмнөх алхамуудыг буюу өмнөх оролтуудыг санаж байгаа бөгөөд энэ нь өгүүлбэр дэх үгс гэх мэт өгөгдөл дэх контекстийг шинжлэхэд тусалдаг.

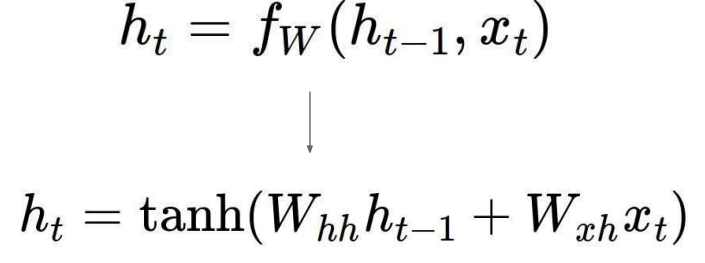

RNN далд төлөвийн шинэчлэл:

Далд төлөв h(t)-ийг, оролтын х(t) болон өмнөх далд төлөв h(t-1) дээр үндэслэн тогтооно.

- W(x), W(h) – жингийн матрицууд

- X(t) – Оролт

- h(t-1) – Өмнөх далд төлөв

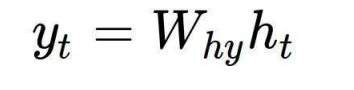

RNN үр дүн гаргах:

Гаралтыг h(t) дээр үндэслэн тогтооно.

Алхам бүрд томьёог хэрэгжүүлснээр векторуудын дараалал x-ийг боловсруулж чадна.

Далд төлөвийг үе бүрт шинэчлэгдэж, сүлжээнд суралцаж өмнөх оролтыг санах боломжтой болно.

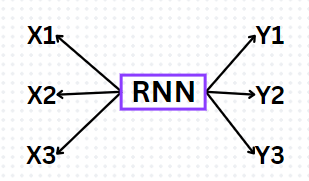

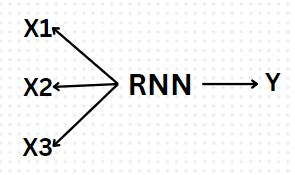

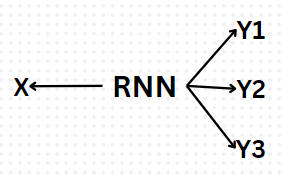

Дарааллыг боловсруулах чадвар нь:

Сүлжээг оролтын дарааллаар тэжээж, дараалсан гаралтыг үүсгэдэг. Жишээ нь: Хувьцааны үнэ гэх мэт time series өгөгдөлд тохиромжтой.

Сүлжээг оролтын дарааллаар тэжээж, эцсийн гаралтыг анхаардаг. Жишээ нь: Сүлжээг киноны оролтоор тэжээж, гаралтанд инээдмийн кино бол 1, аймшгийн кино бол 0 гэх мэт.

Нэг оролтоор тэжээж, дараалсан гаралтыг гаргадаг. Жишээ нь: Оролтыг зургаар тэжээж, зургийг үг бүрээр тайлбарласан тайлбар үүсгэж болно.

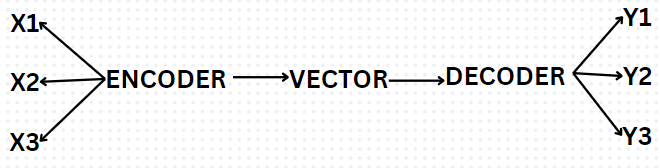

Encoder хэсгийг дарааллаар тэжээж вектор болгон хувиргаж, декодлогч векторыг авч, гаралтыг дарааллаар авдаг. Жишээ нь: Орчуулагч

Бэрхшээл нь:

Градиент дэлбэрэх/Алга болох ба сургалтын нарийн төвөгтэй байдал үүсдэг.

Градиент дэлбэрэх нь шинэчлэлүүд хэт том учраас градиентыг тогтворгүй байлгадаг. Тиймээс градиентийг нормалчлах хэрэгтэй.

Градиент алга болох нь шинэчлэлүүд хэт бага учраас өмнөх оролтуудаас сүлжээг сургахад хэцүү байдаг. Тиймээс RNN-ийн архитектурыг өөрчлөх хэрэгтэй.

Эдгээр асуудлуудыг LSTM, GRU шийдвэрлэдэг.

RNN Давуу тал:

- Ямар ч урт оролтыг боловсруулж чадна

- Алхам t-ийн тооцоолол нь (онолын хувьд) олон алхамын мэдээллийг ашиглаж болно.

- Загварын оролтын уртын хэмжээ нь өөрчлөгдөхгүй.

- Timestep болгонд ижил жинтэй тул оролтыг хэрхэн боловсруулдагт тэгш хэмтэй байдаг.

RNN Сул тал:

- Recurrent тооцоолол удаан.

- Практикт олон алхамын мэдээлэл авахад хэцүү.

Хайлт

Категори

- 1 минутын уншлага

- 2 минутын уншлага

- AI

- Algorithm

- Bиртуалчлал

- Competitive programming

- computer science

- ide

- webiste

- Аюулгүй Байдал (4)

- боловсрол

- Зөвлөгөө

- Инженерчлэл ба Технологийн Системүүд (2)

- Код

- Компьютерын Шинжлэх Ухаан ба Програмчлал (1)

- Крипто

- Математик

- Өгөгдөл ба Хиймэл Оюун Ухаан (3)

- Программ хангамжийн төсөл

- Систем

- Сурагчдад

- Тархи ба Код

- Технологи, Нийгэм ба Боловсрол (5)

- Технологийн түүх

- Тоглоом хөгжүүлэлт

- Хөндлөнгийн

- Электроник